搜索

搜索

“正大期货"

扫码下载APP

作者: 正大期货 来源:https://www.xasswkj.com/ 阅读次数:次 2023-06-20 07:20 【字体: 大 中 小】

ChatGPT让人工智能再次引起科技界的轰动,一起也激起了方针拟定者、顾客倡议集体以及企业领导层的警惕。他们遍及要求为这种前沿技能拟定标准,以保证其开展路途的可控性和可继续性。

几个月前,马斯克赞助的生命未来研讨所(Future of Life Institute,FLI)发起了一场具有影响力的揭露信签名运动。该运动强烈呼吁先进大模型研讨应至少暂停6个月,意图在于对当时人工智能开展的快速胀大进行深化反思,因为这或许正导致咱们失掉对这项技能的操控。

上个月,人工智能安全中心(Center for AI Safety,CAIS)发布了一份瞩意图简略声明。这份声明得到了OpenAI和DeepMind的高档管理人员、图灵奖得主以及其他AI范畴的领军研讨人员的一起签署。他们称AI这一堪比“疫情和核战争”的技能或对人类构成生计要挟。

不过,与许多AI慎重派不同,以“深度学习三巨子之一”杨立昆(Yann LeCun)为代表的达观派并以为,咱们应该愈加耐性,愈加信任科技的前进;AI现阶段仍处在它的青涩和天真期,咱们远未抵达那个需求紧急举动的点。

这两派的敌对并非细枝末节的学术争辩,而是关于人类怎样看待技能的问题,是人类把技能看作是东西,彻底受人类操控,仍是把它看作或许脱离人类操控,乃至危及人类存亡的潜在要挟。

1、达观派:AI不如狗

上星期三的Viva Tech大会上,Meta首席AI科学家杨立昆被问及AI现在的束缚。

“这些体系依然十分有限,它们对实际国际的底层实际没有任何了解,因为它们彻底是在许多的文本上承受练习的。”杨立昆说,“大部分人类的常识与言语无关……所以人类经历的那一部分并未被AI捕捉到。”

“这告知咱们,人工智能还缺失了一些真实重要的东西……别说是赶上人类的智力水平了,人工智能现在是连狗都不如。”杨立昆总结道。

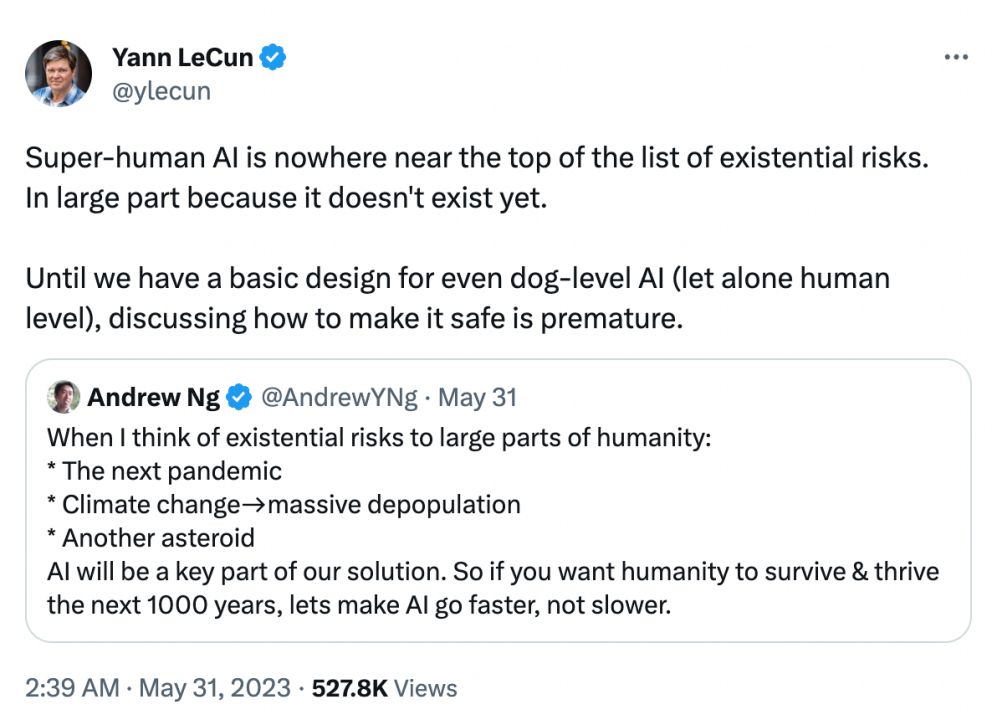

这并不是杨立昆初度讲话“AI不如狗”,在上月底350位AI范畴大佬签署CAIS安排的联名揭露信时,杨立昆转发了同是达观派华人科学家吴恩达的推文表明:

“在人类最重要的生计问题清单上,底子排不上逾越人类的人工智能。首要是因为它还不存在。直到咱们能规划出最少到达狗狗水平的智能(更不用说人工智能了),再来谈安全问题也不迟。”

当然,“AI不如狗”本质上输出的结论是,人类并没有真实规划出超级智能体系,议论安全或操控问题有些为时过早。至于怎样愈加全面地辩驳AI要挟论,他供给了两个更有力的证明视点。

其一,人们不会给现阶段的AI以彻底自主权:

杨立昆指出,现阶段的自回归模型如GPT-4,尽管具有强壮的天然言语处理才能,但其输出结果是不行猜测和难以操控的。无论是改动练习数据的计算信息,仍是调整问题的方法,都无法直接地束缚这些AI模型以满意某种特定方针。

这种状况天然引发了一系列的忧虑。人们在某种程度上假定,一旦答应这些AI体系自在地做任何咱们能经过互联网衔接的作业,让它们有自在运用网络资源的权限,那么它们或许会做出一些张狂的、不沉着的,乃至或许带来危险的行为。一些人忧虑,咱们将无法操控这些AI体系,它们会逃脱咱们的操控,乃至或许操控咱们,因为它们的规划更大,所以它们的智能也会增强。

但是,这种观念其实是没有根据的,或许说是朴实的幻想和夸张。未来被颁发自主性的体系,应该是能够规划一系列举动、有清晰方针且易于操控的。因而,杨立昆猜测,沉着的人不会运用彻底主动的大言语模型,他们会转向更杂乱、可操控的体系。

其二,智力和操控欲毫无关联性:

许多人以为,智能实领会因为比人类更聪明而想要分配人类。但是,杨立昆以为这是个误解。智力高并不意味着就有分配别人的愿望,这更多的是与进化和生物性质相关。

人类、黑猩猩、狼、狗等社会动物会想要影响别人,是因为它们在进化过程中建立了这种愿望。而关于非社会动物如长颈鹿来说,它们并没有分配别人的愿望。因而,操控愿望和才能与智力是两个不同的概念,它们之间没有必然联系。

此外,谈及AI带来的失业问题,他以为关键在于怎样分配财富,怎样安排社会使每个人都能从中获益。这是一个政治问题,不是技能问题,也不是人工智能形成的新问题,而是技能进化形成的。

在杨立昆、吴恩达等达观主义者的观念中,能够发现一个共同:任何新技能在初度出现时,都不或许*无缺。

实际上,人类需求的是一种能够操控的方法,束缚技能或许带来的损害,对其进行有效地监管,并处理或许的恶性用例。彻底中止研制进程并不是一个正确的决议计划。人类应该坚持对技能前进的尊重和容纳,而不是因为惧怕不知道而过早地否定其潜在的价值。

2、慎重派:心思各异的联盟

相较于达观派,慎重派的阵营好像人数更多,也反响了人道的一种遍及趋势。当新的事物出现时,它往往会引发人们的忧虑和疑虑。这是人类对或许带来颠覆性改动的新技能所发生的天性反响。

在两轮的揭露签名活动中,能够看到慎重派的声响和影响力逐渐增强。当这种关于“AI危险”的评论在外界引发了广泛地考虑和评论的一起,一些质疑声响也不断出现。

关于“AI的危险和损害”,这个论题已经成为了一个表态的舞台,每个参加者都希望在这场风潮中刻画自己的正面形象。

但是,问题在于,这场大评论真的有用吗?外表看起来,好像每个人都在积极参加,但实际上,却鲜有人真实采纳举动。这种现象在必定程度上显得像是在糟蹋咱们的时刻。“那些创造出AI技能的人参加这种声明,其实无非便是为了给自己获取好名声。”这是不少业界人士对这种现象的点评。

就连“人工智能之父”,德国计算机科学家于尔根·施密德胡伯(Jürgen Schmidhuber)也表明,许多在揭露场合对人工智能的危险提出正告的人仅仅在寻求宣扬。

当然,在一些人或许企图使用这种状况来提高自己的知名度的一起,不乏也有一些独特的见地。

中国科学院主动化研讨所人工智能道德与管理研讨中心主任曾毅,也在CAIS安排的这封揭露信中签名。他以为,揭露信的意图并不是阻止人工智能的开展,而是绝大多数人有权力知道人工智能的潜在危险,研制者们也有责任保证人工智能不给人类带来生计危险,至少要保证这种危险的最小化。

在他的观念中,人工智能对人类生计所或许带来的要挟,能够从两个不同的视点进行剖析:

假如将目光放到无限远,远到通用人工智能和超级智能到来,AI智力水平或许远超人类,那么或许就会像许多影视作品出现的那样,视人类好像蝼蚁,与人类抢夺资源,乃至危及人类生计。

假如只看现在和不远的未来,今世人工智能仅仅看似智能的信息处理东西,不具有真实的了解才能。但曾毅以为,正因为它们算不上真实的智能,不了解什么是人类、什么是存亡和什么是生计危险,才有或许会以人类难以预期的方法犯下人类不会犯的过错。而这恰恰是更急迫的关心地点。

风趣的是,这好像正好在辩驳杨立昆的两大首要观念。

此外,慎重派阵营中,三位“人工智能教父”中的两位辛顿(Geoffrey Hinton)和本吉奥(Yoshua Bengio)也赫然在列。他们曾因在深度学习方面的作业,与杨立昆一起取得2018年“图灵奖”。

但是,与杨立昆的观念相左,本吉奥在承受采访时坦言,他开端对自己这一生的作业效果发生了一种“苍茫”的感觉。本吉奥以为,一切致力于构建强壮AI产品的企业都应该进行正式的注册和报备。“政府需求对这些公司的举动进行追寻,对其作业内容进行检查,对AI工作至少要实施像对待航空、轿车或许制药等范畴相同的监管机制。”

辛顿则在近期辞去了谷歌的作业,并正告这一技能范畴的继续开展或将带来巨大危险。辛顿表明,“我总在用这样的托言安慰自己:哪怕我自己不做,其别人也会这样做。但现在真的不知道要怎样避免坏蛋使用 AI 来作恶。”

辛顿关于AI的忧虑首要有两个方面。首要,他忧虑AI会彻底替代那些需求许多回忆的作业,这或许会对许多工作和工作发生深远影响。其次,跟着AI逐渐获取编写和运转本身代码的才能,他忧虑AI终究或许替代人类的方位。

3、写在最终

上文中敌对两派的观念,其实也有重合的当地。关于现在的 AI 是否具有危险以及该怎样战胜,两派代表人物杨立昆和奥特曼观点共同。他们都以为,即使危险存在,但能够经过细心的工程规划,减轻或按捺它。

能够必定的是,跟着AI技能的不断开展和深化,两派之间的争辩和争议仍将继续不断。

不过相关于国外如火如荼地评论,国内对AI道德和危险的重视相对较少。商场好像更专心于AI大模型怎样改动各行各业,并对此感到高兴和振奋。

原因或许在于,一方面为了在全球比赛中攫取讲话权,商业公司首要需求缩小与国外AI大模型的距离;另一方面,也正因为国内的AI大模型才能还未进入不知道前沿,咱们对AI或许带来的要挟并未给予满足的重视。

在此布景下,国内的AI创业者更倾向于保持一种技能达观主义的情绪,他们不希望过早收敛本身开展,以为这将相当于提早屈服,抛弃了与国外竞赛的时机。

总的来说,这次的争辩并非毫无意义的口舌之争。它为咱们供给了一个抱负的舞台,让咱们深化探讨AI的未来走向,以及怎样以人类的才智和经历,来引导这一范畴的开展,使其真实地服务于人类社会,而非反过来操控咱们。

从这场剧烈的争辩中,能够清楚地看到,人类现在正站在一个严重的决议计划点。无论是挑选达观地拥抱AI的开展,仍是慎重地审视其或许带来的危险,都需求意识到,现在所做的每一个决议,将会影响人类和AI之间的联系,也将刻画人类对未来的幻想和希望。

免责声明:此消息为 正大期货原创或转自合作媒体,登载此文出于传递更多信息之目的,并不意味着赞同其观点或证实其描述,请自行核实相关内容。文章内容仅供参考,不构成 正大期货投资建议。